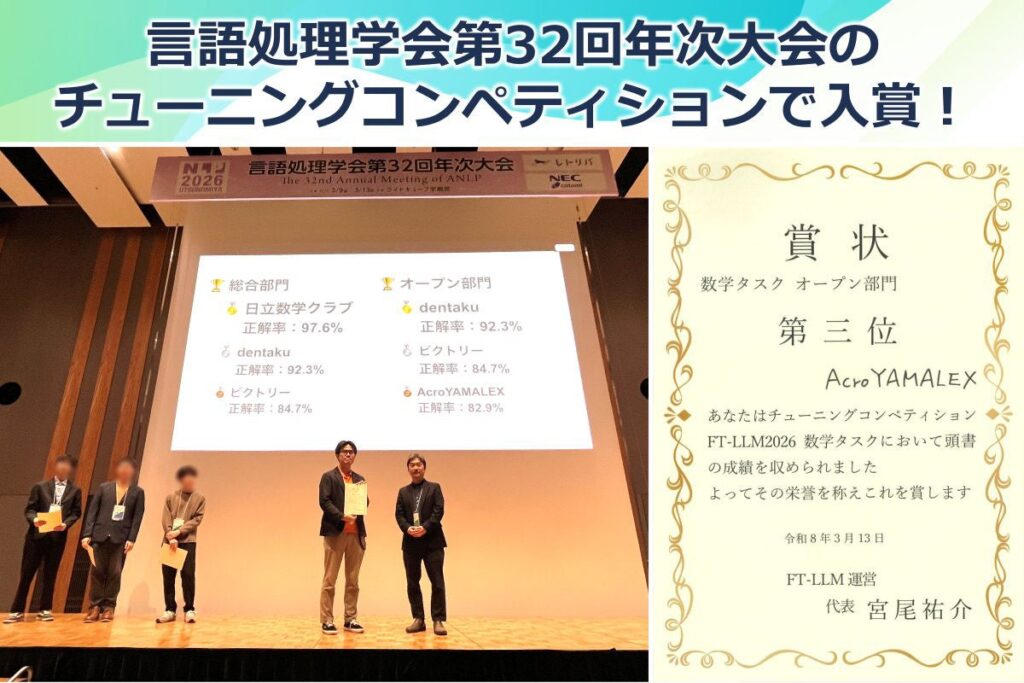

アクロクエストテクノロジー(横浜市港北区)のデータサイエンスチーム「AcroYAMALEX」は、言語処理学会第32回年次大会(NLP2026)内で開かれたチューニングコンペティションの数学タスク部門で第3位に入賞しました。参加は全24チームでした。

競技は第2回「大規模言語モデルのファインチューニング技術と評価」ワークショップの一環で、日本の中学校・高等学校レベルの数学問題に対する回答精度を評価しました。ファインチューニングは既存の大規模言語モデル(LLM)を追加学習で特定用途に最適化する手法です。

同チーム(佐々木峻、山本大輝、樋口慎、吉岡駿)は、最終システムをOSSライセンスで公開することが条件の「オープン枠」で参加し、オープンライセンスのモデルとデータセットのみを使用しました。加えてLLMで合成データを作成し学習データを拡張することで、精度向上につなげたとしています。

同社は今後、AI・機械学習やデータ分析の技術向上を進め、顧客課題の解決や新たなサービス創出に取り組む方針です。

【関連リンク】

詳細URL:https://llm-jp.github.io/tuning-competition/2026/workshop.html

NLP2026公式:https://anlp.jp/nlp2026

AcroYAMALEXとは:https://www.acroquest.co.jp/business/acro-yamalex

お問い合わせフォーム:https://www.acroquest.co.jp/company/contact-all

AI生成記事のため誤りを含む場合があります

PRTIMES

PRTIMES

言語処理学会 NLP2026 チューニングコンペティションでAcroYAMALEXチームが数学タスク部門 第3位を受賞